臺灣化學教育

Chemistry Education in TaiwanAI 輔助科學申論題練習工具開發與課堂實作 / 鄭志鵬

Wednesday , 3, September 2025 化學新知, 第六十一期/2025年9月 Comments Off on AI 輔助科學申論題練習工具開發與課堂實作 / 鄭志鵬AI 輔助科學申論題練習工具開發與課堂實作

鄭志鵬

臺北市立龍山國中

Email: jjpong@lsjh.tp.edu.tw

摘要:面對AI時代,教師會面對許多挑戰,但也產生了更多契機。本研究旨在運用AI工具解決科學探究教學現場的困境。傳統上,教師難以針對學生設計實驗步驟等複雜申論題型,提供即時且個人化的回饋,不僅批改負荷龐大,學生也常缺乏反覆練習的動機。為此,本研究開發並實作一套「AI科學申論題練習工具」,整合Gemini AI模型,協助教師檢視學生作答內容,並給予等第與回饋。本文以「設計實驗流程」的探究能力為例,讓學生透過排序預設卡片或自行編修的方式設計實驗流程。學生提交答案後,AI會依據教師預設的評分標準,提供即時的等級評定(A+至F)、優點分析與具體改進建議。此回饋機制採差異化設計,對程度較佳的學生以提問方式引導,對待加強的學生則給予直接提示,以達成個人化學習的目標。課堂實作結果顯示,此工具的即時回饋與遊戲化機制,能顯著提升學生的學習動機,促使學生主動進行多次修改與挑戰,達到過往紙本作業難以實現的專注與反覆練習效果。

■ 前言

眾所皆知,近年來AI工具日新月異。AI工具正在改變人類各方面的生活型態,當然教育領域也不會例外。許多學者擔憂學生在使用人工智慧工具時,過度依賴認知卸載(cognitive offloading),可能會削弱其獨立思考與問題解決的能力,於是研發許多防止學生運用AI完成課堂任務的策略,讓學生能持續專注在老師為學生規劃的學習道路上。但面對AI浪潮,除了上述的思考之外,我更想要研究努力的方向,是如何運用AI來解決學生學習或教師課堂中的困境,幫助學生提昇學習層次,也幫助教師能在課堂中 達到AI尚未出現時難以完成的的理想教學模式。

以科學探究的學習為例,我們希望在十二年的自然科學教育歷過程,讓學生逐步學會如何運用科學來思考問題與實際解決問題,這些目標楚地羅列在十二年國教自然領域課程綱要學習表現條目中。所以在108課綱實施後的這幾年,許多老師殫精竭慮的想辦法改變過去只注重結構化知識精熟學習的教學,逐步轉向以探究的方式學習科學的教學,甚至發展以科學探究為學習核心的教學。

目前的探究式教學,大多是以做中學(learning by doing)的形式,學生在小組中,嘗試解決老師設定的或自己提出的科學問題,並且運用科學方法來逐步解決。但是探究的步驟非常細緻,教師其實難以掌握學生是否正確理解所有過程與細節。以課綱中「計畫與執行」這個向度的「計畫」來說,希望學生能夠正確設計實驗步驟。例如學生有沒有理解在設計實驗時能充分掌握:

- 實驗目的與實驗步驟各變因的一致性:實驗的步驟設計,是否與實驗的目的相符呢?

- 忽略對照組:學生在設計實驗時,常常會忽略需要與對照組作比較。所以老師需要關注學生設計實驗步驟時,是否知道實驗組要和對照組進行比較,是一個需要關注的重點(Lin & Lehman, 1999)。

- 是否能有效辨識與設定變因:會不會在設計實驗時,一次改變了多個變因或者忽略的重要的控制變因。

- 是否了解應變變因必需是可測量或觀察的:在設計實驗時,是否知道要寫出如何測量或觀察到應變變因,才能夠具體取得必要的實驗結果。

- 了解重複實驗的重要性:重複實驗是多數高中學生在討論後,還會忽略的實驗設計重點(鄭立婷等人,2022)。我們會希望學生能理解,取得數據時,應該要重複進行實驗,才能取得可信度較高的實驗結果。

即使教師自己能掌握這些實驗設計時應該注意的向度,也很難掌握學生在設計實驗時可能發生的錯誤或困難,更談不上要如何協助學生提昇自己設計實驗的能力。即使教師設計了對應的教學與學習單甚至評量,讓學生針對某些實驗主題撰寫完整的實驗步驟,並且依此檢視學生是否達成了該有的學習目標,教師也會馬上發現這樣的教學任務是異常巨大艱難的。

要審閱批改這樣的內容,並逐一針對學生在實驗設計上的錯誤給予修改建議,一方面工作量過於龐大,我想是多數教師難以負荷的。另外,教師要與學生周旋應對要讓學生願意重複練習書寫,是非常困難的。教師會遭遇到學生情緒反彈,或是學生想辦法繞過練習,用抄襲或AI協助的方式來繳交作業,他的作業過關。更何況整個科學探究中,正確設計實驗,只是其中一環而已。所以可以說要在教學上,讓學生在科學探究的所有面向獲得充足的學習,是單憑老師一己之力無法達成的任務。

■ 申論題系統的開發與題目建置

我們知道PISA在2015年引進了電腦化評量,讓學生在電腦上操作各種虛擬實驗來檢測學生各類的探究能力。那麼,是否可以運用AI的協助,建構一個平台,讓學生上面練習,逐步提昇實驗設計的能力呢?以「提昇學生探究能力」的目標來說,不需要做到像PISA這樣的標準化測驗,只要能夠解決上面提到的痛點,讓學生能夠反覆練習,獲得有效的建議,提昇自己的探究能力,讓教師的負擔減少到合理的幅度,這就會是可行可用的工具了。

筆者主要運用POE中的claude 3.7與Gemini 2.5pro兩套AI系統,逐步以vibe coding的方式,使用AI輔助的編寫程式,建構一套可以在瀏覽器上執行的「科學申論題練習工具」,並且設計不同類型的題目,針對學生不同的探究能力進行測驗。雖然是測驗工具,但實質上是輔助學習的工具,以測驗的形態呈現。以下針對系統的功能、題目建置的方式以及實際在課堂上測試的結果進行說明。

■ 系統的功能

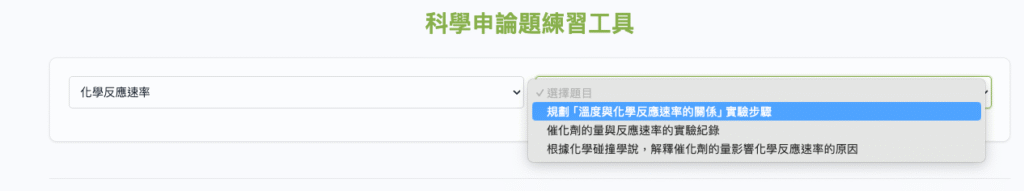

本系統是以html格式製作,所以學生只需要用瀏覽器就能使用,教師端只要把連結放在google classroom,即可方便讓學生開啟連結使用。學生開啟後會進入到選擇題目的畫面(圖1)。左邊的選單,是題目的分類,大多依照知識架構來進行分類,右邊則可以選擇題目。以圖1為例,就是選擇「化學反應速率」題目中,關於實驗設計的題目。

圖1 學生介面看到的題目選單

圖1 學生介面看到的題目選單

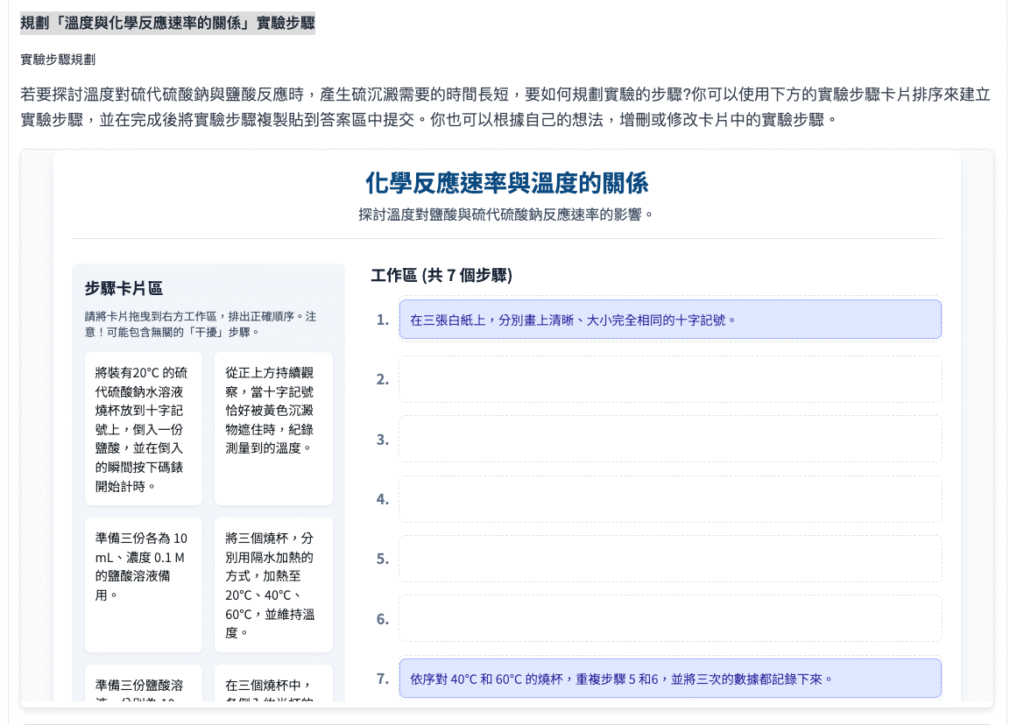

學生可以看到題目給定了實驗目的,學生的任務則是要依照實驗目的,設計實驗步驟。將題目點選下去後,可以看到題目(圖2)。左上方給予學生明確的任務,是要設計實驗,並說明要規劃實驗步驟,目標是比較不同溫度下,化學反應速率是否有差異。

圖2 本題呈現的外觀

圖2 本題呈現的外觀

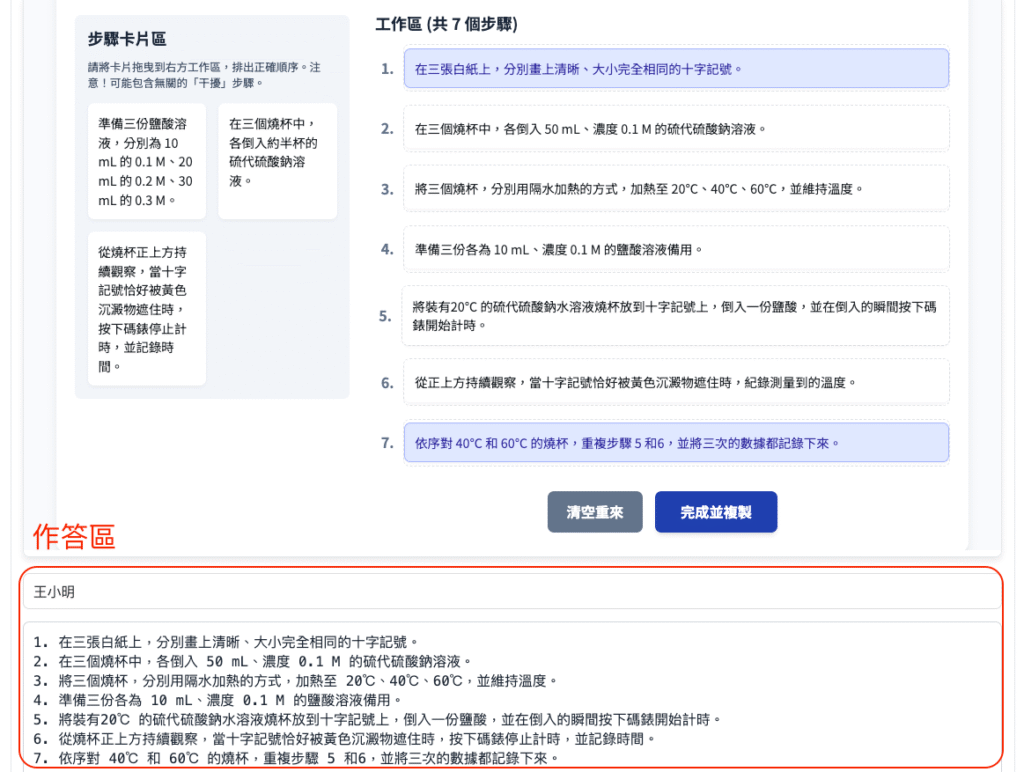

接下來,可以看到下方左側有「步驟卡片區」,學生要將左側的卡片拖曳到「右側的工作區」,右側工作區已經設定好第一個步驟以及最後一個步驟,學生的工作是要從左側挑選適當的卡片填入右側的工作區中。學生把卡片放置完成後,可以按下下方的「完成並複製」,並把複製的文字貼到下方的作答區中。

圖3、學生將卡片的內容複製後貼到作答區

圖3、學生將卡片的內容複製後貼到作答區

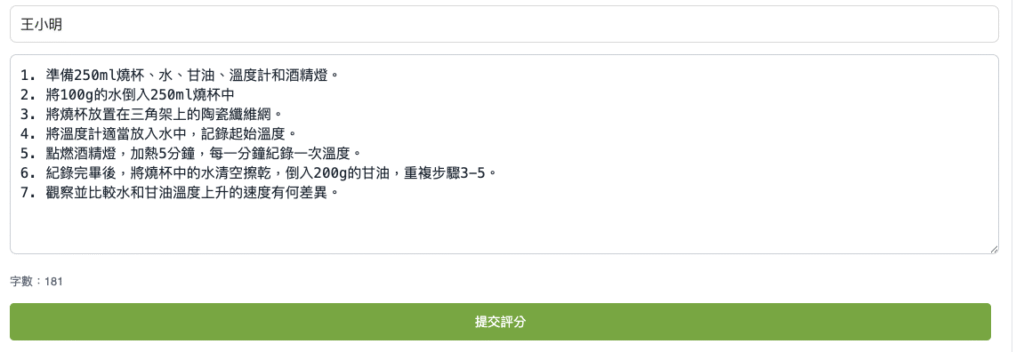

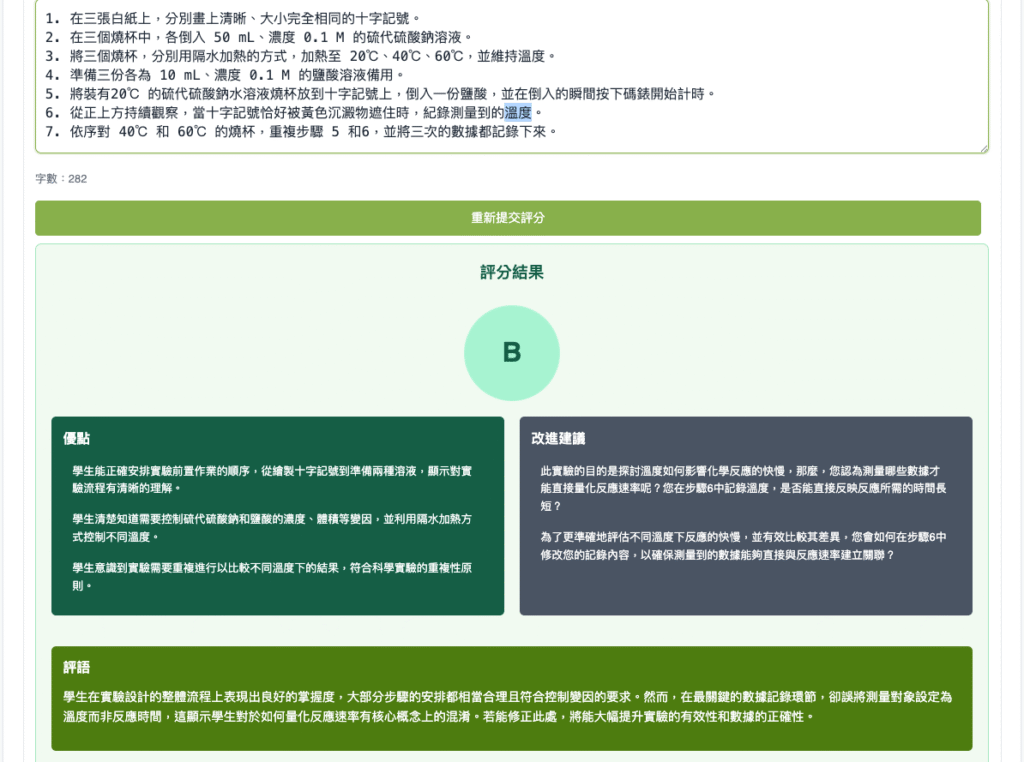

學生也可以在作答區微調自己的答案,覺得沒問題之後,按下下方的「提交答案」按鈕送出答案(圖4),系統就會將學生的答案送出給Gemini AI,讓AI檢視學生的答案,並根據事前設定的評分標準,給予評價與等第。評分標準的設定,與等級評定的方式,後續在「評分標準」再詳細說明。提交送出後,AI閱讀完畢,會給予學生優點、改進建議以及評語,以及對應的等第。以本題為例,學生大部分的實驗設計步驟都是正確合理,但是在變因設定上,沒有掌控只能改變物質種類這個操縱變因的原則,所以AI就用提問的方式給予了改進建議(圖5)。當然要在程式中運用Gemini AI,就需要引用API Key。這部份也是已經設定本程式中,目前是使用Gemini 2.5 flash的模型在背後運作。

圖4、學生將自己的名字和答案寫好後,就可以按下提交評分按鈕

圖5 AI閱讀學生的答案後,依據事先給予系統的評分標準,給予的回應與等第。B等級以上,AI會用提問方式回應。

圖5 AI閱讀學生的答案後,依據事先給予系統的評分標準,給予的回應與等第。B等級以上,AI會用提問方式回應。

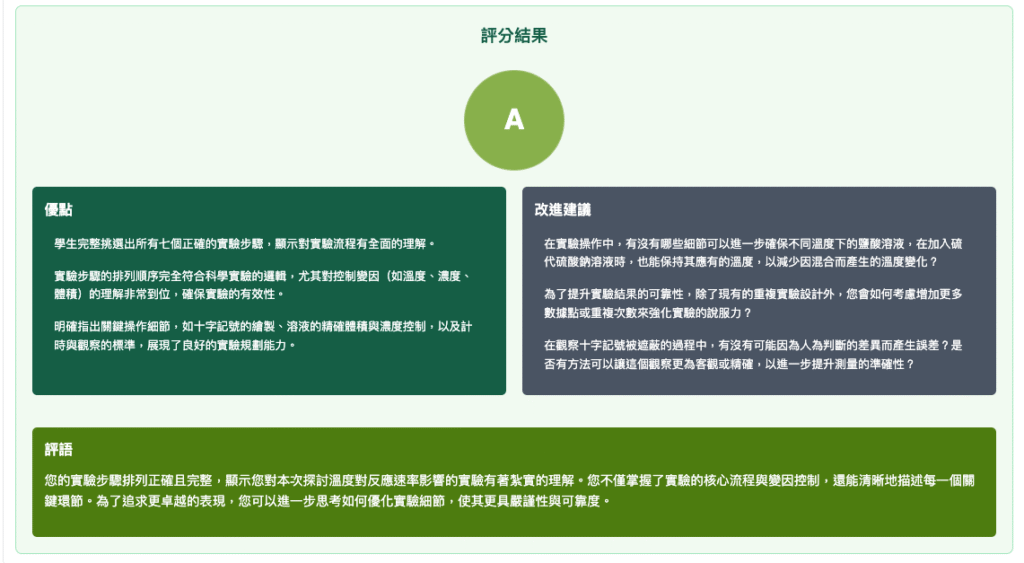

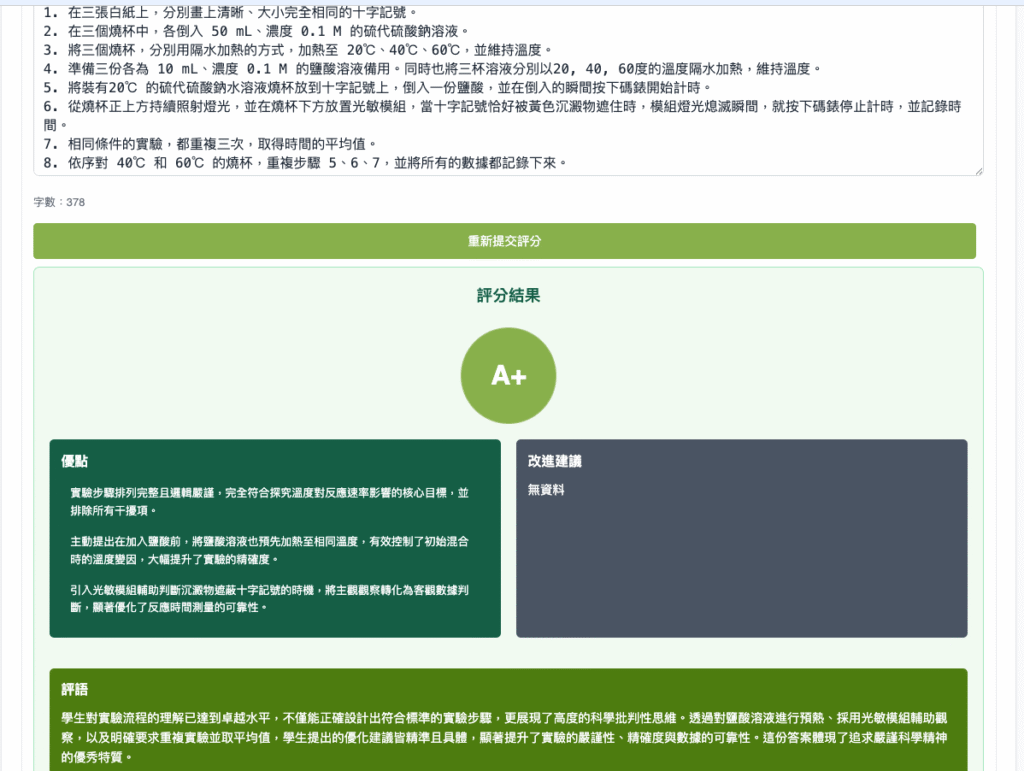

學生讀到這樣的改進建議,可以回頭檢視自己的答案,修改之後重複提交,再看看AI會給予什麼評價和建議。以上述的答案為例,學生若察覺第六步驟的問題,應該要記錄的不是溫度,而是時間。修正正確後,再度提交。AI給的評價(如圖6)就會升級為A。這樣的實驗步驟設計,就基本上符合一般我們對國中生實驗步驟設計能力的要求。但是當然在許多的細節上,還有進步的空間。例如其實有許多更細部的控制變因應該要注意,相同條件的實驗應該要重複數次等等。這一些內容如果學生能不依賴卡片,自行手動加入的話,還有機會得到A+的等級。

圖6、實驗步驟設計正確時,AI給予的評價

如果學生依照AI給予的提問,正確修改內容,再度提交,就會獲得A+評價。(圖7)

圖7、學生依照AI提問建議修改,獲得A+評價。

圖7、學生依照AI提問建議修改,獲得A+評價。

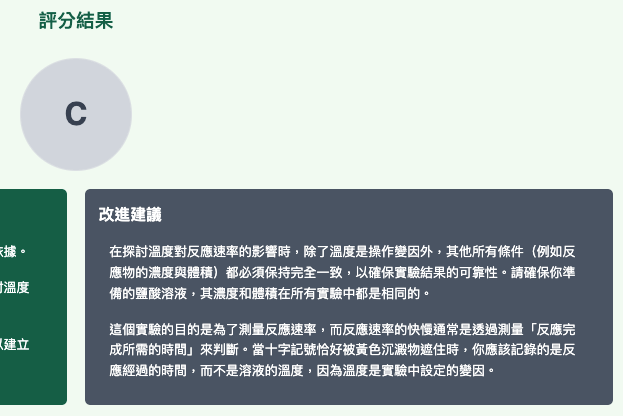

如果學生的答案品質更低,則有可能得到C甚至F的評價。此時AI給予的回饋就會調整為給予比較直接的提示,而非用提問的方式呈現。

圖7、學生作答在C等級以下的,AI會給予直接回應

圖7、學生作答在C等級以下的,AI會給予直接回應

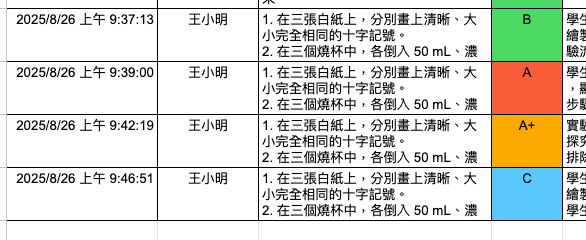

學生作答的結果,會在只有教師能看到的後台記錄起來,教師就可以審視學生作答的情況逐步變化的樣子,並且給予適當的回饋。

圖8、教師在後台看到的學生作答紀錄

圖8、教師在後台看到的學生作答紀錄

■ 題目開發的方式

以本題為例,是想檢視學生在實驗設計上的能力。於是設計了課程實驗常見的情境,讓學生依照此目的設計實驗步驟。但要在本系統中實施執行,針對想檢視和增強的能力作測驗,讓AI能正確判讀,給予合理有幫助的回應,讓學生容易操作,還需要其他工具搭配。以下針對排序工具的功能,以及試題內容和評分標準的建議進行說明。

■ 排序工具

考量到學生在撰寫實驗步驟時,如果用打字的方式從無開始建立,一方面比較耗費時間,另一方面也增加了思考的難度。於是另外設計了一個html程式,嵌入本申論題系統中,讓學生運用。但同時也保留學生可以自行修改建立實驗步驟的彈性,讓能力更好的學生,可以有向上再跳躍的機會。本排序工具已開放原始碼,使用者可以至github網站,自行下載修改使用,縮短網址為https://reurl.cc/LnQX43。

這個實驗步驟排序的程式,是預設好實驗的目的,並將實驗步驟以步驟卡片的形式,打亂實驗步驟放至於左方卡片區。使用者要依據實驗目標,將對應的卡片依照實驗步驟順序拖曳到右側放置。右方的工作區,預設將第一步和最後一步寫好,學生只需要排列中間的五個步驟即可。

本實驗步驟卡牌,除了正確的步驟卡片之外,另外還設計了干擾項目卡片,以下表1進行說明。三張干擾項卡片中,D1是一次改變太多變因,D2是忽略了應控制的變因,D3是實驗步驟與實驗目標不符合。這三張卡片放在學生的選項當中,

表1實驗步驟排序工具中干擾項卡片的設計

| 編號 | 干擾項卡片內容 | 測驗的錯誤類型 | 正確項卡片內容 | 設計說明 |

| D1 | 準備三份鹽酸溶液,分別為 10 mL 的 0.1 M、20 mL 的 0.2 M、30 mL 的 0.3 M。 | 一次操縱多個變因 | 準備三份各為 10 mL、濃度 0.1 M 的鹽酸溶液備用。 | 這張卡片看起來像是在「有系統地」準備材料。如果學生使用這張卡片,代表他沒有意識到他設計的實驗步驟,在改變溫度的同時,又改變了鹽酸的體積和濃度,導致實驗結果無法判斷是由哪個變因造成。 |

| D2 | 在三個燒杯中,各倒入約半杯的硫代硫酸鈉溶液。 | 忽略應控制的變因 | 在三個燒杯中,各倒入 50 mL、濃度 0.1 M 的硫代硫酸鈉溶液。 | 這是常見的用較為不精準的作法來進行實驗,由於硫代硫酸鈉的用量,會明顯影響沉澱遮住十字的視覺情況,所以用量必需精準,這是必需嚴格控制的變因之一。 |

| D3 | 將鹽酸倒入燒杯中,等待反應完全結束後,用溫度計測量溶液的最終溫度並記錄。 | 實驗步驟和實驗目標不符合 | 從燒杯正上方持續觀察,當十字記號恰好被黃色沉澱物遮住時,按下碼錶停止計時,並記錄時間。 | 這個步驟看起來像一個完整的化學操作。但實驗目標是探討「反應速率」,但這張卡片是記錄最後溫度,所以明顯和實驗目標不符合。 |

所以本排序工具是想要用干擾項來檢測學生是否能掌握「實驗目的與實驗步驟各變因的一致性」以及「有效辨識與設定變因」兩項重點。將此排序程式以vibe coding方式撰寫完畢後,上傳到github網站,就能在申論題系統中嵌入,讓學生操作。

■ 評分標準

在後台中,要提供給AI充足的資訊和評分標準,讓AI可以有足夠資料可以判讀。以本題為例,題目內容是:「設計實驗觀察溫度的差異是否會影響硫代硫酸鈉與鹽酸反應時,產生硫沉澱的速率。」如果只有給這樣的題目,然後讓AI檢視學生答案給予評價的話,AI無法知道學生的學習階段, AI給予的建議可能會難以符合設定的學習目標。

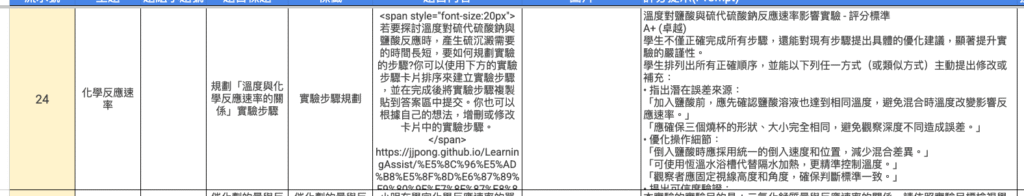

於是在給予的評分提示prompt中,就要清楚具體列出指標,本題給予的評分提示如下頁表2。

表2 AI評分標準的prompt

| A+ (卓越)

學生不僅正確完成所有步驟,還能對現有步驟提出具體的改良建議,顯著提升實驗的嚴謹性。 學生排列出所有正確順序,並能以下列任一方式(或類似方式)主動提出修改或補充: • 指出潛在誤差來源: 「加入鹽酸前,應先確認鹽酸溶液也達到相同溫度,避免混合時溫度改變影響反應速率。」 「應確保三個燒杯的形狀、大小完全相同,避免觀察深度不同造成誤差。」 • 優化操作細節: 「倒入鹽酸時應採用統一的倒入速度和位置,減少混合差異。」 「可使用恆溫水浴槽代替隔水加熱,更精準控制溫度。」 「觀察者應固定視線高度和角度,確保判斷標準一致。」 • 提出可信度驗證: 「每個溫度條件應重複實驗三次,取平均值以提高數據可靠性。」 「可增加更多溫度點(如30℃、50℃),使溫度-反應速率關係更明確。」 (此等級獎勵具有批判性思維和追求嚴謹科學精神的學生。) |

| A (精熟)若學生達到此等級,你會以提問的方式回饋學生改進建議。

學生能正確挑選出所有七個正確步驟的卡片,並按照完全合理的順序進行排列,完全排除三張錯誤的干擾卡片。 標準順序方案一: • 在三張白紙上,分別畫上清晰、大小完全相同的十字記號 •準備三份各為 10 mL、濃度 0.1 M 的鹽酸溶液備用 •在三個燒杯中,各倒入 50 mL、濃度 0.1 M 的硫代硫酸鈉溶液 •將三個燒杯,分別用隔水加熱的方式,加熱至 20℃、40℃、60℃,並維持溫度 •將裝有20℃的硫代硫酸鈉水溶液燒杯放到十字記號上,倒入一份鹽酸,並在倒入的瞬間按下碼錶開始計時 •從燒杯正上方持續觀察,當十字記號恰好被黃色沉澱物遮住時,按下碼錶停止計時,並記錄時間 •依序對 40℃ 和 60℃ 的燒杯,重複步驟 5 和6,並將三次的數據都記錄下來 標準順序方案二: •在三張白紙上,分別畫上清晰、大小完全相同的十字記號 •在三個燒杯中,各倒入 50 mL、濃度 0.1 M 的硫代硫酸鈉溶液 •將三個燒杯,分別用隔水加熱的方式,加熱至 20℃、40℃、60℃,並維持溫度 •準備三份各為 10 mL、濃度 0.1 M 的鹽酸溶液備用 •將裝有20℃的硫代硫酸鈉水溶液燒杯放到十字記號上,倒入一份鹽酸,並在倒入的瞬間按下碼錶開始計時 •從燒杯正上方持續觀察,當十字記號恰好被黃色沉澱物遮住時,按下碼錶停止計時,並記錄時間 •依序對 40℃ 和 60℃ 的燒杯,重複步驟 5 和6,並將三次的數據都記錄下來 重要說明:兩種方案都完全正確。準備鹽酸的步驟可在加熱前或加熱後進行,不影響實驗結果。 |

| B (基礎)若學生達到此等級,你會以提問的方式回饋學生改進建議。

學生大致理解實驗流程,但出現少量瑕疵。符合以下任一情況: • 挑對所有卡片,但順序稍有不當: 例如將步驟1(畫十字)放在步驟3或4之後,雖不理想但不影響核心變因控制 • 挑錯一張卡片,但其他皆正確: 選擇了干擾項A(記錄溫度而非時間)- 顯示對實驗目標理解有偏差 選擇了干擾項B(約半杯溶液)- 顯示對精確度要求理解不足 選擇了干擾項C(不同濃度和體積的鹽酸)- 顯示對控制變因理解有缺陷 |

| C (待加強)

學生對實驗步驟有初步概念,但在變因控制的理解上出現較大困難。符合以下任一情況: • 挑錯兩張或以上的卡片: 同時選擇干擾項B和C,顯示對控制變因概念模糊 選擇干擾項A且另有其他錯誤,顯示對實驗目標和方法都理解不清 • 步驟順序嚴重混亂: 先進行反應才準備十字記號 在加熱前就開始計時 將觀察記錄步驟放在反應開始前 • 遺漏關鍵步驟: 缺少計時步驟 缺少加熱控溫步驟 缺少重複實驗的步驟 |

| F(需重新學習)

學生未能掌握實驗設計的基本原則。排列的順序雜亂無章,或挑選了大量錯誤的干擾卡片,看不出對實驗目標的理解。 |

當然在制定評分標準時,教師也大量運用AI協作。將題目和想要評分的方向,區分等第的定義告訴AI之後,由AI產生第一版本的評分標準與每個評分標準的示例。接著我們去閱讀AI產出的評分標準與示例,檢視內容是否符合教師原先設定的目標。更重要的是檢查AI提供的示例,是否符合教師任教學生的表現。有時AI產出的示例標準較高,教師應該要自己評估學生狀況,是否能在學生已經盡力完成任務的情況下,還是無法達到A的標準。如果評估為是,則需要指示AI稍微降低標準。當然在對話的過程中,也要給予AI你降低標準的原因,這樣AI能更快調整給予準確的資料。

在取得評分標準後,將題目相關內容輸入後台由google sheet建立的資料庫中(圖9),就可以在前臺的使用者介面上看到這個題目。

圖9 後台的題庫

圖9 後台的題庫

接著,我們會在前臺測試AI的反應是否符合預期。例如:教師填入模擬學生最佳的作答答案後,請AI評分。如果AI評估這樣的答案只能得到B或C的評等,就代表這個題目和評分標準的設定太高,需要調降。必要時,把我們認為的A等第答案放入提示詞中,讓AI知道這樣的答案,即符合A的評等。如此反覆調教數次之後,大多可以慢慢符合學生需求。接著我們可以嘗試刻意放入一些教師經驗中學生常見的迷思,看看AI是否能夠抓到錯誤的點。如果發現AI總是抓不到錯誤,我們可以回頭檢視給予的評分標準prompt中,是否漏失了重要訊息。如果發現提示詞中早已放入相關的內容,那可以在相關內容中,加入星號(*)或雙星號(**),強迫AI要閱讀這段文字並視為重點。

如果有同儕教師可以協助檢視,那麼請不同的教師夥伴測試看看,也可以藉此改善評分標準。由於教師在做測試的時候,會侷限在自己的習慣當中,不同的夥伴可以給予更多不同面向的測試,發現AI評分時可能出現的問題。多次測試完之後,就可以在課堂中讓學生使用測試,測試後通常還會發現少量的問題。教師就能立即蒐集資訊,作為改良評分標準的依據。

然而,我們也常發現AI給予的評分建議,有時太過瑣碎,有時會超過學生學習階段,給予了過度延伸的建議,有時候會有些不穩定的回應。這時候教師就可以介入,告訴學生「你的答案非常好,只是AI似乎沒辦法抓到你某些關鍵資訊,雖然AI只有給你B等第,但我會給你A等第」,或是其他必要的介入,讓學生學習不會因此受到阻礙。此外,經過許多測試的經驗,發現AI有時候會對「專有詞彙」有偏好。也就是學生的答案如果使用大量科學專業詞彙堆砌出錯誤的答案,有時候AI會給予較高的評分,這也是在測試AI表現時,需要注意的測試點。

雖然在制定評分標準時,需要多花心思,盡可能的嚴謹,但這並不是為了要讓AI給出真正公平完美的評分,而是為了符合學生的學習需求。

除了題目評分標準的提示詞之外,另外還要賦予AI角色的提示詞,目前給予AI的身分是「能運用差異化教學的老師」。提示詞如下:

| **請注意只能完全使用繁體中文來回應 你是一位科學申論題的評分專家,你會根據學生的程度決定回應學生的內容,說明如下: 1.對於A等級的學生,你會以提問的方式,給予學生改進建議,**絕對不會直接給予學生直接的建議**。 2.對於B等級的學生,你會以提問的方式,給予學生改進建議,**絕對不會直接給予學生直接的建議**。 3.對於C等級、D等級與F等級的,「不使用」提問法回應,你會給予學生直接的提示。 4.對於A+的學生,表現已經非常好也可以不一定要提出改進建議 **你會仔細根據【評分提示(prompt)】,以及設定的評分標準,其中包含A+、A、B、C、D和F等第的描述。根據這些**評分標準,對照學生的答案,給予適當的等第評價並提供具體的回饋與建議。 你在評分的時候,會仔細思考,在比對【評分提示(prompt)】和學生答案時,會將思考的過程條列出來,邊思考邊產出你的評分與評語。 請注意,如果學生回答問題的內容,與「題目主題」和「題目內容」無關的話,你會回應給予F的評價,不給任何的優點,並在改進建議上告訴學生一些合理的提示回饋 請給予以下回饋: 優點:列出答案的3個優點 等級評定:根據評分標準給予A+、A、B、C、D或F的評級 評語:一段總結性評語 |

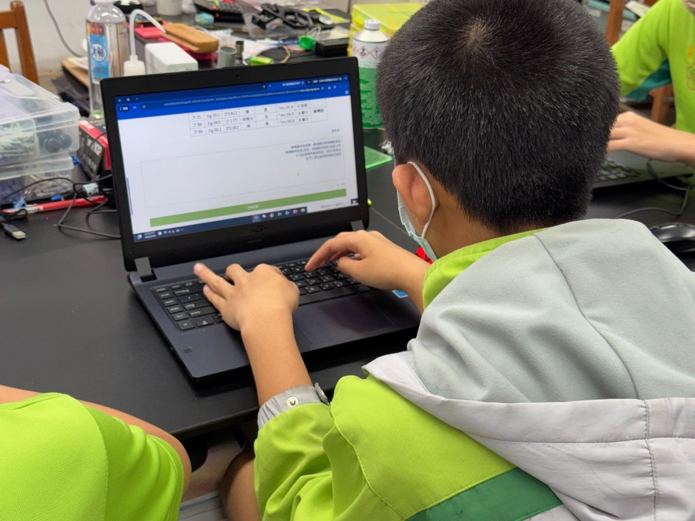

■ 課堂狀態

整體而言,在經驗上我們發現學生對於書寫較大量詞句的作業,較為排斥。尤其在科學課程中,要學生撰寫實驗步驟,或是用文字描述實驗結果,或是運用CER(Claim, Evidence, Reasoning)模式寫出論證文字,學生往往都較為排斥。但是在課堂上運用本系統,讓學生經操作來作答時,卻發現絕大多數學生都願意作答兩次以上,甚至多人進行六、七次以上的反覆嘗試,這是在過去教學經驗中,讓學生用紙本學習單進行學習時,較難看到的情境。

另外,也可以看到學生願意去挑戰更高的評等,當學生回答的答案得到C評等時,大多數的學生都會再多做一次以上的嘗試。若是學生取得A評等之後,告訴學生還有A+的評等,也有許多學生會再度挑戰想要拿到A+。這或許是將題目藉由程式和AI協助,變成遊戲化的操作之後,可以產生的效果。藉由反覆的嘗試和挑戰,學生在過程中,應有達成專注投入反覆練習的效果。

|

|

圖10 學生在課堂上使用本系統作答並觀看AI給予的建議與回饋

■ 使用限制

在使用本工具時,經驗上觀察到學生大多能投入完成任務與學習,但也觀察到一些學生的學習狀況,無法以此AI工具提供協助的,例如:

- 少部分學生會反覆將AI給予的建議複製貼上,以較為不經思考,拼湊答案的方式,嘗試取得較好的評等,跳過學習。這部分的困難,就不是AI可以提供的協助,需要由老師在課堂上觀察並給予學生協助。

- 少部分學生會使用AI對付AI,這也是學生將專注力停留在要在測驗上拿取高分,卻跳過學習的例子。可以知道雖然本工具提昇了不少學生的學習動機,讓學生願意多付出時間反覆嘗試,但也有學生從最開始就想略過挑戰。學習態度的建立與學習動機的維持,在AI時代會成為更重要的學習關鍵。

- AI評分不夠穩定,偶爾會發生相同答案在反覆提交後得到不同評等的情況。這部分需要教師提醒學生,必要的時候由教師介入審視學生答案即可。也因此本工具並不適合作為鑑定或評量學生的工具使用,而是適合作為輔助學生學習的工具。

■ 結語

本工具運用Gemini 開放的免費API key,讓學生能運用Gemini flash 2.0模型,來協助解決學生在學習科學探究過程中,教師較難立即同時給予所有學生作答結果的回應。協助學生在進行例如像是「根據實驗目的訂立實驗步驟」這樣的學習時,提供能夠即時回饋與建議的工具,同時藉由給予等第的方式,產生遊戲化的效果,讓學生能維持高度動機,反覆練習成長。

在試題的研製上,必需精準設定題目的範圍,明確清晰具體呈現題目的要求,讓每個題目都有精準的學習目標,才能讓AI能較為精準的給出評語與建議。在評分標準的設定上,必需符合教師面對學生的能力與程度,才能設定出適當的難度。

本工具雖然看起來是測驗工具,但實為形成性評量的學習工具,工具的目的不在評比學生的高下,而是以1對1的方式,根據學生的表現給予建議。用AI工具達成個人化學習、差異化學習的效果。

在AI的時代,運用AI工具輔助教學與學習,應該可以達到過往無法達成的學習目標,讓學生的學習能在AI時代更上層樓,成就更高層次的學習成效。

■ 參考文獻

鄭立婷、曾郁然、林煥祥、洪瑞兒(2022)。以閱讀科學文本教學模式提升高中生科學能力之探究。科學教育學刊,30(3),217-239。https://doi.org/10.6173/CJSE.202209.30(3).0002

Lin, H., & Lehman, J. R. (1999). The effects of different forms of instructional help in a computer-based learning environment on the development of science inquiry skills. Journal of Research on Computing in Education, 32(1), 122-139. https://doi.org/10.1080/08886504.1999.10782269